36 氪獲悉,6 月 7 日,虎博科技正式發布并開源其自研大模型 TigerBot。同時,虎博科技還發布了大模型應用開發所需的全套 API,以及多領域專業數據。

虎博科技成立于 2017 年,是一家專注于深度學習及 NLP(自然語言處理)技術的 AI 公司,36 氪曾多次報道。此前,經過多年技術探索和積累,虎博科技已經擁有包括智能搜索、智能推薦、機器閱讀理解、總結、翻譯、輿情分析及撰稿在內的關鍵技術,亦有全球各行業的專業信息數據積累。

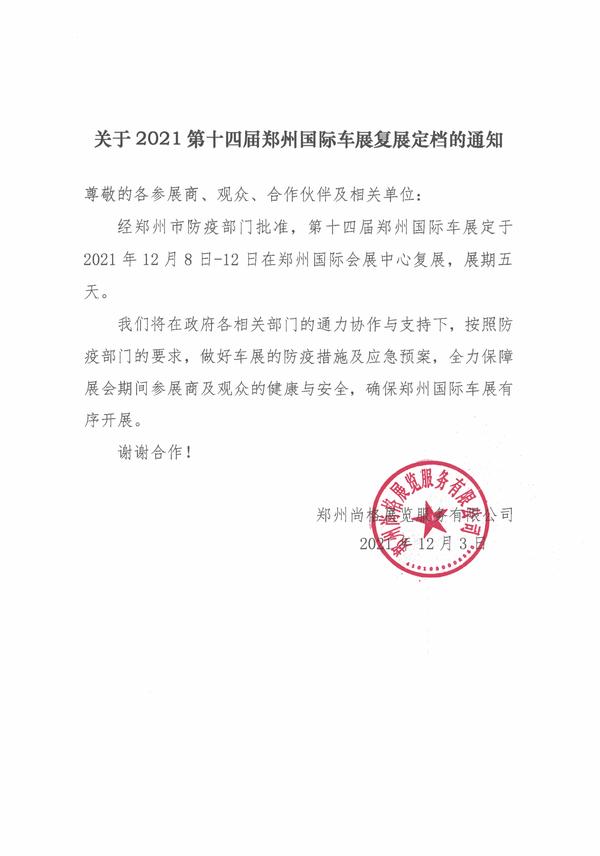

(相關資料圖)

(相關資料圖)

2022 年 11 月,OpenAI 發布 ChatGPT,掀起了全球的 AI 大模型科技浪潮,中國市場也出現了不少團隊自研 AI 大模型的嘗試,虎博科技也是其中之一。

本次虎博科技所發布的自研大模型 TigerBot,是一個多語言多任務大規模語言模型,經歷 3 個月的封閉式開發和超過 3000 次實驗迭代,當前已經迭代出第一個 MVP 版本。

從功能上,Tigerbot 已經包含大部分生成和理解類的能力,具體包括幾大部分:

內容生成:輔助用戶解決創作類問題,快速生成營銷文案、評論、新聞稿等等。另外,Tigetbot 也支持圖片生成——模型可以實現文生圖,進行插圖創作等

圖片生成

開放問答:用戶向 Tigerbot 提出問題,比如烹飪攻略、長文本總結、文本理解、角色對話、潤色等等

開放式問答

提取信息:比如有目的地獲取關鍵信息、提取數字、主要內容等等

長文本解讀

在 3 個月封閉開發背后,是一支精干的團隊。虎博科技創始人兼 CEO 陳燁對 36 氪表示,在大模型研發上,虎博團隊致敬了硅谷經典的 " 車庫創業 " 模式,團隊開始只有 5 個人,CEO 同時擔任首席程序員及首席 AI 科學家。

" 在大模型的研發上,我們堅信頂尖團隊能起到的作用,團隊規模不必太大,但技術需要過硬。在我們從 0 到 1 的研發過程中,我們核心的研發團隊一直保持在 4-5 個人,以及密切合作的研發狀態。" 陳燁表示。

從模型效果上看,虎博 Tigerbot 根據 OpenAI InstructGPT 論文的公開 NLP 數據集上進行評測,TigerBot-7B 對應 OpenAI 同等規模的 6B 版本,其綜合表現能夠達到 OpenAI 效果的 96%。

以 OpenAI-instruct GPT-6B-SFT 為基準,歸一化并平均各模型的得分情況 來源:虎博科技

在過去三個月中,虎博科技主要基于 GPT 和 BLOOM 兩個開源模型基礎上,在模型架構和算法側做了一系列優化。陳燁對 36 氪表示,虎博科技在技術突破上,主要集中在原創的監督和微調方法上。" 從整個技術角度來說,監督微調的方法是大模型這件事的核心,能夠影響模型效果的七到八成。"

比如,大模型浪潮來臨后,困擾業界的一個難題在于大模型的 " 幻覺 " ——即大模型輸出的結果,和人類說的話一樣自然,但在事實層面會 " 胡說八道 "。

陳燁以實際案例舉例,針對這一問題,虎博應用了一些經典的監督學習方法,如 Ensemble 和 Probabilistic Modeling,結合到大模型中。

" 假設人類在問模型一個事實性問題,Tigerbot 不會只是簡單地生成自然語言,而是同步利用更少量的數據就能知道人類意圖——在回答上,則會更好的權衡事實性和創造性。" 陳燁補充。這樣的結果是,機器在訓練模型中算力和數據的消耗,會比同等檔次模型要小。

針對中文語境,虎博科技從分詞器(Tokenizer)到訓練算法等方面做了針對性算法優化,使得模型更懂中文指令,提高了問答結果的中國文化屬性。(注:這里調后了一段,因為在模型里,事實性和創造性決定了它是不是會胡說八道,中文環境的針對性算法優化,可以讓它更懂中國人的交流,類似于幾個同學在一起,總有 1 個比其他人文學底蘊更好一點)

而在并訓練上,虎博的大模型團隊也突破了比如 deep-speed 等主流框架中若內存和通信問題,使得在千卡環境下,可實現訓練數間斷。

虎博科技在大模型研發上選擇走開源路線。此次開源內容包含模型、代碼、數據三部分,包含 TigerBot-7B-sft、 TigerBot-7B-base、TigerBot-180B-research 等多個模型版本;基本訓練且覆蓋雙卡推理 180B 模型的量化和推理代碼;以及達 100G 的預訓練數據、監督微調 1G/100 萬條數據。

目前,這些內容已經全部在 Github 中發布(鏈接見此)。之所以選擇開源路線,陳燁表示,推進人類文明的技術變革往往源于本能、直覺和偶然性,擁有自由的創新精神是根本。

" 大模型技術就像是一門新興學科,是顛覆式且長周期的,未來的可能性超越 PC 和互聯網。現階段過早和過于理性地探討產品、應用、場景和商業化或許沒有必要,更重要的是推廣這一人工智能基礎設施的原創突破,促進技術的發展和更新。"

出于上述的考慮,虎博除了一部分積累的預訓練數據集,也同時開源了系統性的中文數據搜集和清洗方法論。陳燁并不認為數據會成為壁壘:" 更重要的是團隊對于數據清洗的理論和系統性的高度,這是一個長期的系統工程。"

虎博科技自成立之初就專注在中文 NLP 的技術和產品研發上,積累了大量高質量的中文預訓練數據,本次發布的 100G 預訓練數據,就是其中的一部分。未來,虎博還將開放大量的金融、法律、百科等領域專業數據,供應用開發者使用。

此前幾年,虎博科技基于 NLP,開發了主要面向泛金融領域的 NLP 產品,如輿情監測、搜索、知識圖譜等,也已經用 api 的方式服務 B 端客戶。本次大模型的發布也會與虎博的業務相結合——當前,虎博科技已經面向老客戶提供包括內容生成類的功能模塊。陳燁表示,大模型技術浪潮來臨后,在市場側感覺 " 客戶決策速度比以前更快,產品落地速度也更快。"

未來,虎博科技將持續投入力量到大模型的研發和落地中。陳燁談及了正在研發或者正在完善的一些功能,如研究助手 TigerDoc、文創和營銷工具等,虎博科技也正在內測部分面向個人的類助手產品。

歡迎交流

歡迎關注

-

全球時訊:5月末我國外匯儲備規模為31765億美元

頭條 23-06-07

-

年內四次增持!重慶水投成重慶銀行第五大股東

頭條 23-06-07

-

中石油北京項目管理公司:胡某勇被免去相關職務 并接受紀委核查 世界觀天下

頭條 23-06-07

-

2022年信托行業評級初評結果出爐

頭條 23-06-07

-

天天快資訊:鄭州海昌海洋公園一期預計年內開業,14.36億銀團貸款落地

頭條 23-06-07

-

當前速訊:辣椒種植、鄉村建設有了5G“大腦”,河南鄉村振興跑出“加速度”

頭條 23-06-07

-

多家大行6月8日起下調人民幣存款利率_全球快播報

頭條 23-06-07

-

要聞:鄭東新區牽手豫信電科,圍繞先進計算、數字政府建設等領域合作

頭條 23-06-07

-

新資訊:零容忍!微信進一步打擊不良直播PK行為

頭條 23-06-07

-

河南種業集團更名完成!注冊資本5億元,侯傳偉任董事長

頭條 23-06-07

-

寧德時代重挫帶崩鋰電板快,機構:新能源賽道已不再擁擠

頭條 23-06-07

-

揭秘!高考試卷從命題到進考場全流程→_當前熱訊

頭條 23-06-07

-

環球時訊:億利潔能資金懸疑:手握43億現金卻致7億票據逾期?

頭條 23-06-07

-

@河南高考考生,忘帶準考證在這些平臺可下單免費跑腿→

頭條 23-06-07

-

浙江第四批集采確認納入重組人生長激素_全球熱訊

頭條 23-06-07

-

新鄉投資集團將發行10億元中票,申購區間3.20%~4.50% 環球速看

頭條 23-06-07

-

全球時訊:加碼自救!千億地產緊急出招

頭條 23-06-07

-

速遞!河南農擔公司:省財政貼息擔保貸款 助力鄉村產業振興

頭條 23-06-07

-

上海推出今年第五批次集中供應樓盤,備案均價最高為8.91萬元/平方米

頭條 23-06-07

-

焦作市經濟運行工作會議:全力以赴抓招商,推動簽約項目盡早落地

頭條 23-06-07

-

今日報丨長安汽車被曝扣供應商貨款!最新回應稱“內容不實,已報案”

頭條 23-06-07

-

涉卡轉賬、立即停止!中消協:警惕培訓班退費騙局_環球短訊

頭條 23-06-07

-

孟晚舟:萬物正走向可感知、互聯、智能 數字孿生世界正在構建_全球速訊

頭條 23-06-07

-

長安汽車回應網傳克扣10%貨款:不實 已報案 環球快消息

頭條 23-06-07

-

眾泰汽車收關注函,被要求說明*ST龐大是否向公司輸送利益

頭條 23-06-07

-

當前聚焦:剛剛,華為重大發布!孟晚舟發聲

頭條 23-06-07

-

濮陽投資集團將發行5億元中票,申購區間為4.8%~6%_每日報道

頭條 23-06-07

-

陜西省公示47家重點產業鏈鏈主企業 | 名單

頭條 23-06-07

-

天天熱點!鄭州啟動經開綜合保稅區產業轉型升級,公開招標規劃編制

頭條 23-06-07

-

李云澤會見美國花旗集團首席執行官范潔恩_天天快訊

頭條 23-06-07

-

環球熱推薦:河南省自然資源投資集團完成發行3.8億元中票,利率3.88%

頭條 23-06-07

-

比亞迪:將于2023年推出極具專業性、個性化的全新品牌_熱點聚焦

頭條 23-06-07

-

全球最資訊丨中國臺球協會:將從嚴處罰旅英涉賭球員 開展全行業警示教育

頭條 23-06-07

-

河南一批金融機構高管任職資格獲核準 | 名單 全球今日訊

頭條 23-06-07

-

多家大行存款利率將再迎下調,機構稱板塊估值進入配置區間 焦點快播

頭條 23-06-07

-

壽險產品定價利率下調在即 年金險、分紅險有望接力|天天簡訊

頭條 23-06-07

-

蘭考縣投資集團、產投集團揭牌

頭條 23-06-07

-

長安汽車回應被供應商申訴其強行扣10%貨款:未收到申訴 目前內部正在核查 天天熱點評

頭條 23-06-07

-

環球微頭條丨湖南石化注冊成立,由長嶺煉化、巴陵石化整合組建

頭條 23-06-07

-

【全球速看料】浙江擬推薦31家全國商貿物流重點聯系企業 | 名單

頭條 23-06-07

-

商丘將加強縣域商業體系建設:支持縣城商貿流通企業下沉業務_天天日報

頭條 23-06-07

-

16省份公布去年平均工資:多地采礦業收入最高

頭條 23-06-07

-

正式分家!周鴻祎與前妻離婚股份過戶完成,最新市值68億元

頭條 23-06-07

-

河南省二手車出口試點企業評審結果公示,28家企業在列 每日時訊

頭條 23-06-07

-

隔夜歐美·6月7日-每日簡訊

頭條 23-06-07

-

世界聚焦:河南省首次開展審計整改情況再審計再監督

頭條 23-06-07

-

1~5月河南省重點城市房企銷售業績排行榜 天天速看料

頭條 23-06-07

-

"中國取消大規模進口訂單",什么情況?日股徹底瘋狂:暴漲64000億 快看

頭條 23-06-07

-

皮海洲:分拆上市盡可能避免在同一市場內部進行-全球觀察

頭條 23-06-07

-

新動態:多地購房政策優化力度加大,專家:預計房地產行業6月份或迎新的政策出臺

頭條 23-06-07

-

紅杉資本宣布拆分,全球三大區域將不再共用同一品牌 每日時訊

頭條 23-06-07

-

新動態:世界銀行上調中國2023年經濟增速預期至5.6%

頭條 23-06-07

-

洛陽中超股份創業板IPO申請獲受理,擬募資12.4億元

頭條 23-06-06

-

熱文:證監會核發7個企業債注冊批文 總募資約180億元

頭條 23-06-06

-

【環球報資訊】河南組織專家開展科技服務,支持蘭考、睢縣、寧陵、汝陽發展

頭條 23-06-06

- 當前信息:「虎博科技」發布自研多模態大模2023-06-07

- 開“運”隨手拍丨和“水”打了一輩子交道,2023-06-07

- 疑似海盜母船!中國海軍出手相助2023-06-07

- 環球觀速訊丨河南各地加強服務保障 確保收2023-06-07

- 浙江:昔日“爛泥稻田”村 蹚出文旅振興路2023-06-07

- 國企領導與年輕女子親密逛街,公司通報:免2023-06-07

- 每日速遞:應急管理部:5月我國各種自然災2023-06-07

- 拒收房產而收開發商47萬現金,住建局長被舉2023-06-07

- 山東德州一科目三考場曬麥,多名學員掛科,2023-06-07

- 觀察:49歲年輕奶奶抱孫子給19歲的小兒子送2023-06-07

- 全球時訊:5月末我國外匯儲備規模為31765億2023-06-07

- 年內四次增持!重慶水投成重慶銀行第五大股2023-06-07

- 中石油北京項目管理公司:胡某勇被免去相關2023-06-07

- 2022年信托行業評級初評結果出爐2023-06-07

- 天天快資訊:鄭州海昌海洋公園一期預計年內2023-06-07

- 私密抗衰守護者 | 全國女性生殖整形研修2023-06-07

- 今日紙黃金價格走勢最新查詢(2023年6月7日2023-06-07

- 多空相互影響 金價延續震蕩2023-06-07

- 學子奔赴考場!新高考分為“3+3”和“3+1+22023-06-07

- 環球微資訊!四川:因地制宜書寫“土地文章2023-06-07

- 啟程的少年們,愿你們大勝歸來!2023-06-07

- 高考次日天氣如何?這些考場要繼續留意高溫2023-06-07

- 當前速看:高考第一天 全國各地愛心助考 2023-06-07

- 倒計時20天!天津夏季達沃斯論壇6月27日開幕2023-06-07

- 浙江:昔日“爛泥稻田”村 蹚出文旅振興路2023-06-07

- 天天報道:一箭26星發射成功!我國一箭多星2023-06-07

- 看熱訊:中國石油北京項目管理公司通報:胡2023-06-07

- 環球即時:應急管理部:今年5月各種自然災2023-06-07

- 最新:港媒:泰國組合粉絲見面會主持人發涉2023-06-07

- 孫亮受賄、貪污、國有公司人員濫用職權案一2023-06-07