The following article is from 機(jī)器之心SOTA模型 Author 機(jī)器之心SOTA模型

機(jī)器之心專欄

(相關(guān)資料圖)

(相關(guān)資料圖)

本專欄將逐一盤點(diǎn)自然語言處理、計(jì)算機(jī)視覺等領(lǐng)域下的常見任務(wù),并對在這些任務(wù)上取得過 SOTA 的經(jīng)典模型逐一詳解。前往 SOTA!模型資源站(sota.jiqizhixin.com)即可獲取本文中包含的模型實(shí)現(xiàn)代碼、預(yù)訓(xùn)練模型及 API 等資源。

本文將分 2 期進(jìn)行連載,共介紹15個(gè)在視頻生成任務(wù)上曾取得 SOTA 的經(jīng)典模型。

第 1 期:TGAN、VGAN、MoCoGAN、SVG、vid2vid、VideoVAE、DVD-GAN、SWGAN

第 2 期:TGANv2、TGANv2-ODE、VideoGPT、DVG、NWA、StyleGAN-V、Video Diffusion Models

您正在閱讀的是其中的第 1 期。前往 SOTA!模型資源站(sota.jiqizhixin.com)即可獲取本文中包含的模型實(shí)現(xiàn)代碼、預(yù)訓(xùn)練模型及 API 等資源。

第1期回顧:

本期收錄模型速覽

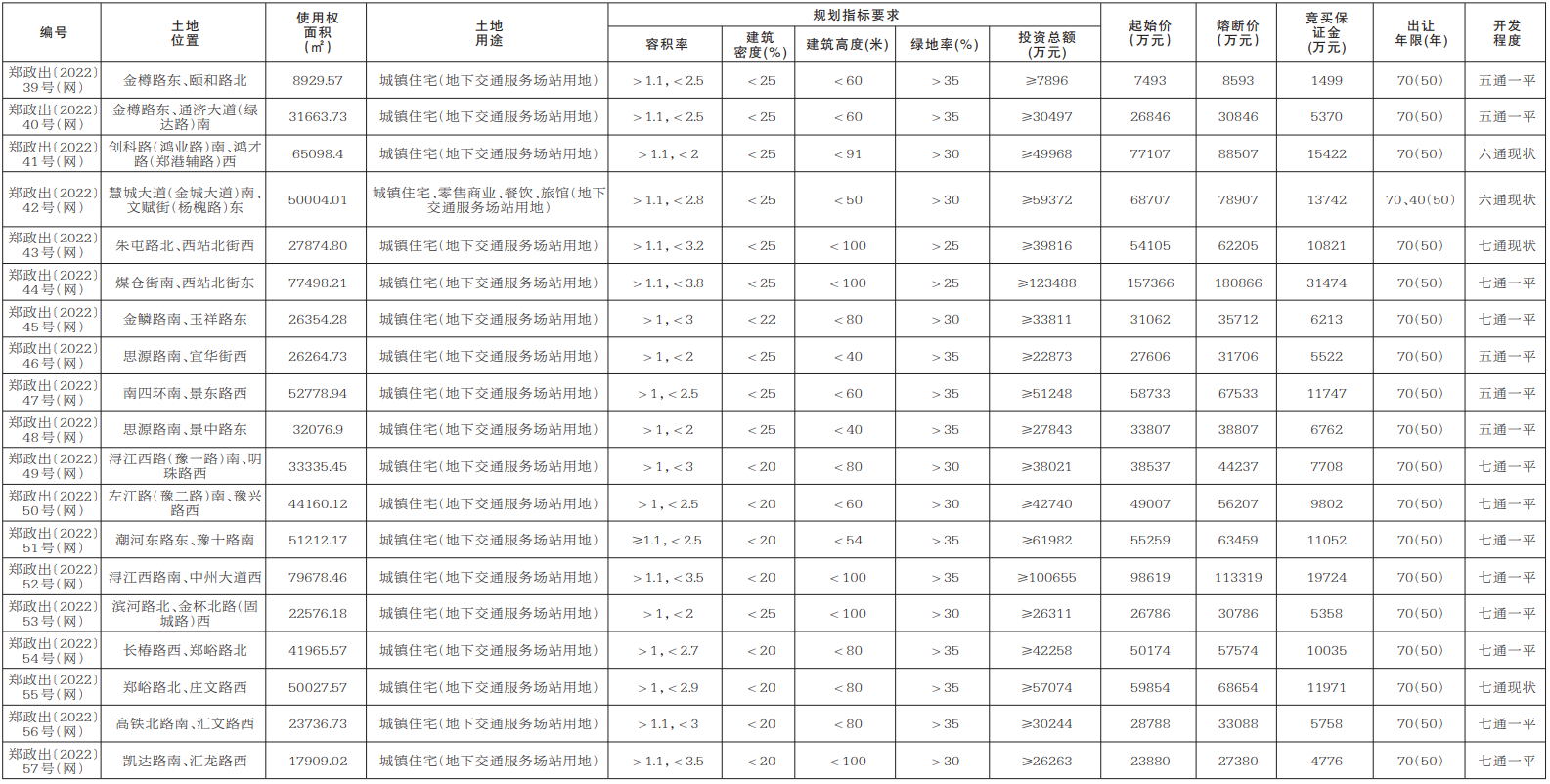

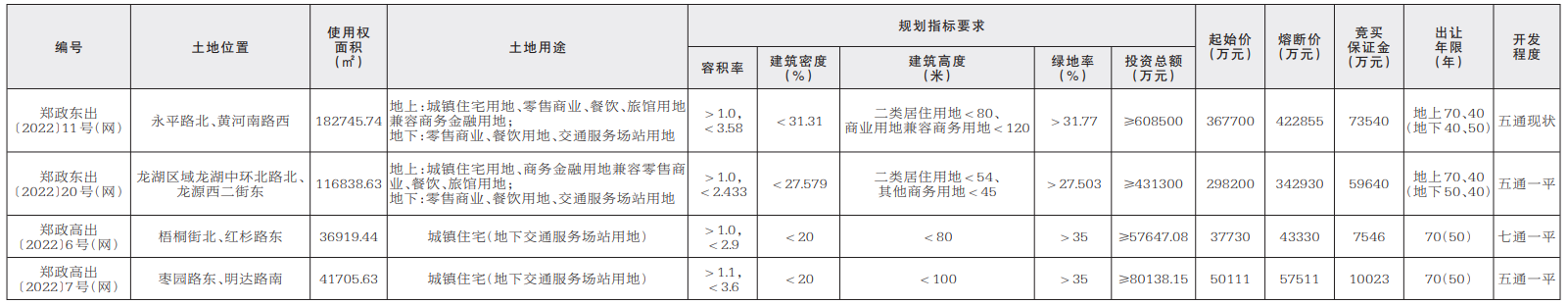

| 模型 | SOTA!模型資源站收錄情況 | 模型來源論文 |

|---|---|---|

| TGANv2 | https://sota.jiqizhixin.com/project/tganv2-2021收錄實(shí)現(xiàn)數(shù)量:2支持框架:PyTorch | Train Sparsely, Generate Densely: Memory-efficient Unsupervised Training of High-resolution Temporal GAN |

| TGANv2-ODE | https://sota.jiqizhixin.com/project/tganv2-ode收錄實(shí)現(xiàn)數(shù)量:1支持框架:PyTorch | Latent Neural Differential Equations for Video Generation |

| VideoGPT | https://sota.jiqizhixin.com/project/videogpt收錄實(shí)現(xiàn)數(shù)量:1支持框架:PyTorch | VideoGPT: Video Generation using VQ-VAE and Transformers |

| DVG | https://sota.jiqizhixin.com/project/dvg收錄實(shí)現(xiàn)數(shù)量:1支持框架:PyTorch | Diverse Video Generation using a Gaussian Process Trigger |

| NWA | https://sota.jiqizhixin.com/project/nuwa收錄實(shí)現(xiàn)數(shù)量:1支持框架:PyTorch | NWA: Visual Synthesis Pre-training for Neural visUal World creAtion |

| StyleGAN-V | https://sota.jiqizhixin.com/project/stylegan-v收錄實(shí)現(xiàn)數(shù)量:1支持框架:PyTorch | StyleGAN-V: A Continuous Video Generator with the Price, Image Quality and Perks of StyleGAN2 |

| Video Diffusion Models | https://sota.jiqizhixin.com/project/video-diffusion-models收錄實(shí)現(xiàn)數(shù)量:2支持框架:PyTorch | Video Diffusion Models |

什么是生成?就是模型通過學(xué)習(xí)一些數(shù)據(jù)生成類似的數(shù)據(jù)。讓機(jī)器看一些動(dòng)物圖片,然后自己來產(chǎn)生動(dòng)物的圖片,這就是圖像生成的,即最終生成的目標(biāo)物是圖像。視頻生成與基于數(shù)據(jù)生成數(shù)據(jù)(圖像)的任務(wù)不同,重點(diǎn)聚焦于了解物體運(yùn)動(dòng)和場景動(dòng)態(tài)。因此,視頻生成(video generation)任務(wù)也被定位于future prediction任務(wù)。不過,創(chuàng)建一個(gè)動(dòng)態(tài)模型是非常具有挑戰(zhàn)性的,因?yàn)槲矬w和場景有大量的變化方式。

深度生成模型最近受到了越來越多的關(guān)注,這不僅是因?yàn)樗鼈兲峁┝艘环N以無監(jiān)督方式學(xué)習(xí)深度特征表征的方法,可以潛在地利用所有未標(biāo)記的數(shù)據(jù)進(jìn)行訓(xùn)練,還因?yàn)樗鼈兛梢杂脕砩筛鞣N視覺應(yīng)用所需的新型圖像。然而,從生成圖像到生成視頻的擴(kuò)展被證明是一項(xiàng)極具挑戰(zhàn)性的任務(wù),盡管生成的數(shù)據(jù)只是多了一個(gè)維度—時(shí)間維度。

首先,由于視頻是對物體進(jìn)行各種動(dòng)作的視覺信息的時(shí)空記錄,生成模型除了學(xué)習(xí)物體的外觀模型外,還需要學(xué)習(xí)物體的合理物理運(yùn)動(dòng)模型。如果學(xué)習(xí)到的物體運(yùn)動(dòng)模型不正確,生成的視頻可能包含物體進(jìn)行物理上不可能的運(yùn)動(dòng)。

第二,時(shí)間維度帶來了大量的變化。考慮到一個(gè)人在做下蹲動(dòng)作時(shí)可以有多種速度變化,每種速度模式都會(huì)產(chǎn)生不同的視頻,盡管視頻中人的外表是一樣的。

第三,由于人類已經(jīng)進(jìn)化的對運(yùn)動(dòng)非常敏感,運(yùn)動(dòng)偽影特別容易察覺。

與在圖像生成任務(wù)中的應(yīng)用類似,GAN仍然是視頻生成中最有效的模型。本文介紹視頻生成必備的TOP模型,主要按照各個(gè)模型提出的時(shí)間順序來介紹,以近兩年的SOTA模型為主。

TGANv2

在視頻數(shù)據(jù)集上訓(xùn)練生成對抗網(wǎng)絡(luò)(GAN)面臨的一個(gè)挑戰(zhàn)就是:視頻數(shù)據(jù)集的規(guī)模太大,而且每個(gè)觀測值都很復(fù)雜。一般來說,訓(xùn)練GAN的計(jì)算成本隨著分辨率的提高而呈指數(shù)級(jí)增長。在這項(xiàng)研究中,提出了一種新型的高分辨率視頻數(shù)據(jù)集無監(jiān)督學(xué)習(xí)的內(nèi)存效率方法,其計(jì)算成本僅與分辨率呈線性比例變化:具體的,通過將生成器模型設(shè)計(jì)成小型子生成器的堆疊,如圖1所示,并以特定的方式訓(xùn)練模型來實(shí)現(xiàn)這一目標(biāo)。訓(xùn)練時(shí),在每一對連續(xù)的子生成器之間引入一個(gè)輔助子采樣層,將幀率按一定比例降低。這個(gè)處理過程可以讓每個(gè)子生成器學(xué)習(xí)不同分辨率下的視頻分布情況,由此只需要幾個(gè)GPU來訓(xùn)練一個(gè)高度復(fù)雜的生成器,該生成器在起始得分方面遠(yuǎn)遠(yuǎn)超過了前者。

圖1. 使用多個(gè)子采樣層的生成器

經(jīng)典temporal GAN(即TGAN和MoCoGAN)使用一個(gè)由兩個(gè)子網(wǎng)絡(luò)組成的生成器:時(shí)態(tài)生成器g0和圖像生成器g1。對于T-幀視頻的生成,時(shí)態(tài)生成器生成一個(gè)大小為T的潛在向量集(或潛在空間中的T-幀視頻){z1, . . zT },圖像生成器將潛在向量視頻和噪聲向量轉(zhuǎn)換為圖像視頻,如圖2所示。

圖2. 經(jīng)典temporal GAN中使用的時(shí)態(tài)生成器和圖像生成器之間的關(guān)系概述。為了生成一組T個(gè)潛在向量,時(shí)間生成器通常是一個(gè)遞歸網(wǎng)絡(luò)

首先描述單次采樣層的GAN的訓(xùn)練。假設(shè)一個(gè)生成器從噪聲向量z輸出視頻x,由兩個(gè)塊組成:抽象塊g^A和渲染塊g^R。在推理過程中,該生成器的樣本生成過程等同于傳統(tǒng)GAN中的生成器,即,G(z)可以表示為

在訓(xùn)練階段,將G修改為G’,在g^R和g^A之間引入一個(gè)子采樣層S^G,以降低從g^A產(chǎn)生的abstract map的幀率。訓(xùn)練階段的目標(biāo)函數(shù)變?yōu)?/p>

給定L個(gè)子生成器,或L個(gè)抽象塊組成的模型。在訓(xùn)練的時(shí)候,這個(gè)架構(gòu)是用L個(gè)相應(yīng)的渲染塊和L-1個(gè)子采樣層來訓(xùn)練的。推理階段,可以簡單地通過連續(xù)應(yīng)用抽象塊來評估x:

在訓(xùn)練時(shí),使用L組子生成器,每個(gè)子生成器都遞歸地將(g_m)^A和(S_m)^G(m = 1, ... , l - 1)應(yīng)用于abstract map,并通過(g_l)^R將最終抽象塊(g_l)^A的輸出轉(zhuǎn)換為視頻。

為了訓(xùn)練上述由多個(gè)子生成器組成的生成器,需要一個(gè)鑒別器為它們生成的視頻集評估一個(gè)分?jǐn)?shù)。鑒別器由多個(gè)子鑒別器組成。D’_l表征第l個(gè)子鑒別器,從第l個(gè)子生成器G’_l中獲取樣本x’_l并返回一個(gè)標(biāo)量值。鑒別器D’利用以下公式對一組x’_l進(jìn)行評分

該方法的本質(zhì)是 the division of roles:不是給單一的大規(guī)模模型提供密集的原始數(shù)據(jù)集,而是用數(shù)據(jù)集的選定部分來訓(xùn)練每個(gè)子生成器,以幫助子生成器提高模擬給定role的能力。具有l(wèi)ow indices的子生成器的作用是在抽象層面上模仿原始視頻數(shù)據(jù)集;也就是說,生成一個(gè)隨時(shí)間自然流動(dòng)的低分辨率視頻。具有l(wèi)ow indices的鑒別器負(fù)責(zé)評估低分辨率的高幀率視頻的質(zhì)量。這使得low indices的生成器能夠捕捉視頻中獨(dú)立于高分辨率細(xì)節(jié)的整體運(yùn)動(dòng)。另一方面,具有high indices的子生成器的作用是模仿原始視頻數(shù)據(jù)集的視覺質(zhì)量。也就是說,只需要一個(gè)高分辨率的低幀率視頻來訓(xùn)練。

論文具體介紹了一個(gè)由四個(gè)子生成器組成的生成器,它可以合成一個(gè)具有T幀和W×H像素的視頻。與TGAN和MoCoGAN一樣,該生成器首先從噪聲向量中產(chǎn)生T個(gè)潛在特征圖,然后將每個(gè)特征圖轉(zhuǎn)換為相應(yīng)的幀(見圖2)。具體的網(wǎng)絡(luò)結(jié)構(gòu)見圖3和圖4。

圖3. 模型的網(wǎng)絡(luò)配置。"CLSTM(C) "代表具有C通道和3×3內(nèi)核的卷積LSTM。"Up(C) "指的是上采樣塊,它返回具有C個(gè)通道和兩倍于輸入分辨率的特征圖

圖4. 論文中使用的塊細(xì)節(jié)。"Conv(C, k) "表示具有C通道和(k×k)內(nèi)核的二維卷積層。"Conv3D(C, k) "表示具有C通道和(k×k×k)核的三維卷積層。"UnPool "表示一個(gè)具有(2×2)核和stride為2的二維 unpooling layer 。"AvgPool2D "表示沿空間維度的二維平均池化層,核為(2×2),stride為2。請注意,它并不沿時(shí)間維度進(jìn)行池化操作。"DownSample "表示下采樣操作。如果輸入的三維特征圖的每個(gè)維度的大小都大于1,該操作符就會(huì)沿著其軸線進(jìn)行平均池化操作(如果在進(jìn)行平均池化操作時(shí)大小為奇數(shù),則目標(biāo)軸的padding被設(shè)置為1)。否則,不對該軸進(jìn)行 average pooling 。Up(C) "中的(-)表示,如果輸入通道的數(shù)量與輸出通道的數(shù)量相等,則不插入括號(hào)內(nèi)的塊

當(dāng)前 SOTA!平臺(tái)收錄TGANv2共 2個(gè)模型實(shí)現(xiàn)資源。

項(xiàng)目SOTA!平臺(tái)項(xiàng)目詳情頁TGANv2前往SOTA!模型平臺(tái)獲取實(shí)現(xiàn)資源:https://sota.jiizhixin.com/project/tganv2-2021

TGANv2-ODE

TGANv2-ODE研究了神經(jīng)微分方程( Neural Differential Equations )對視頻生成的時(shí)間動(dòng)態(tài)建模的影響。神經(jīng)微分方程的范式具有許多理論上的優(yōu)勢,包括在視頻生成過程中首次對時(shí)間進(jìn)行連續(xù)表示。為了解決神經(jīng)微分方程的影響,作者在這項(xiàng)工作中研究了時(shí)間模型的變化如何影響生成的視頻質(zhì)量,最終支持使用神經(jīng)微分方程作為經(jīng)典的temporal生成器的簡單替代。

TGAN用一個(gè)temporal generator G_t將一個(gè)單一的噪聲向量轉(zhuǎn)化為多個(gè)考慮到時(shí)間的向量,這是一系列的一維卷積。然后,將生成的向量與開始的單一噪聲向量連接起來,送入圖像生成器G_i中。G如圖5所示:

圖5. G_t將潛在變量z_c轉(zhuǎn)換為一系列的temporal vectors z0, z1, ..., zT。每個(gè)z_t與z_c串聯(lián)并轉(zhuǎn)化為一個(gè)圖像。上述圖像被連接起來組成一個(gè)視頻

目前,討論temporal generator的選擇的文章非常少,文本提出在一般物理學(xué)常見的范式下對其進(jìn)行探索:使用微分方程來表示temporal dynamics。在使用歷史圖像生成函數(shù)的同時(shí),將觀察不同temporal生成函數(shù)的性能指標(biāo)的變化。生成函數(shù)系列之間的比較可以通過圖6直觀地看到。

圖6. 與典型的LSTM相比,神經(jīng)微分方程的觀察次數(shù)更多,SDE( Stochastic Differential Equations )的解決潛力更大

可以用微分方程( Ordinary Differential Equations , ODEs)代替自動(dòng)回歸的LSTM或1D核來模擬潛在變量z_t的演變。通過學(xué)習(xí)函數(shù)f(z_t),可以通過積分找到未來的z_T:

然后圖像生成器G_i(z)可以從z_t產(chǎn)生一個(gè)圖像。使用微分方程,該模型可以解釋traversing潛在空間的細(xì)微差別,并說明z_(t ODE允許在確定的系統(tǒng)中進(jìn)行路徑近似。每個(gè)z_t都會(huì)產(chǎn)生一個(gè)z_t+1,但這并不反映視頻的真正功能。SDEs可能是表征視頻中存在的隨機(jī)性的一個(gè)好方法,它提供了ODEs的所有好處,同時(shí)允許隨機(jī)性與它們的附加噪聲。令μ(z_t)和σ(z_t)分別代表漂移和擴(kuò)散,我們發(fā)現(xiàn)z_T有: (z_t)和σ(z_t)中的每一個(gè)都是由一個(gè)神經(jīng)網(wǎng)絡(luò)設(shè)定的參數(shù)。W_t是一個(gè) Wiener 過程,是一個(gè)具有高斯增量的連續(xù)數(shù)值系列。這種表述的有效性可以通過思考一個(gè)人臉表情變化的視頻來體現(xiàn)出來。如果演員一開始是中性臉,他們之后可能會(huì)產(chǎn)生一個(gè)悲傷的臉。然而,微笑也是同樣可能的。通過注入隨機(jī)性,任何一條路徑都可能被模型探索到。 微分方程由于其連續(xù)的特性,可以增加對路徑traversed方式的控制。因?yàn)閦_t是通過積分找到的,所以具有兩個(gè)其他方式所不具備的獨(dú)特特征:首先,z_t可以在時(shí)間上向后整合,允許發(fā)現(xiàn)z_t-n,即在第一幀之前發(fā)生的事情。第二,可以很容易實(shí)現(xiàn)幀率提高。微分方程求解器可以對z_(t 當(dāng)前 SOTA!平臺(tái)收錄TGANv2-ODE共1個(gè)模型實(shí)現(xiàn)資源。 項(xiàng)目SOTA!平臺(tái)項(xiàng)目詳情頁TGANv2-ODE前往SOTA!模型平臺(tái)獲取實(shí)現(xiàn)資源:https://sota.jiqizhixin.com/project/tganv2-ode Video-GPT VideoGPT是一種概念簡單的架構(gòu),用于擴(kuò)展基于似然的生成對自然視頻進(jìn)行建模。Video-GPT將通常用于圖像生成的VQ-VAE和Transformer模型以最小的修改改編到視頻生成領(lǐng)域。VideoGPT使用VQVAE,VQVAE通過采用3D卷積和軸向自注意力學(xué)習(xí)降采樣的原始視頻離散潛在表示。然后使用簡單的類似GPT的架構(gòu)進(jìn)行自回歸,使用時(shí)空建模離散潛在位置編碼。VideoGPT結(jié)構(gòu)如圖7: 圖7. 把訓(xùn)練管道分成兩個(gè)連續(xù)的階段:訓(xùn)練VQ-VAE(左)和訓(xùn)練潛在空間的自回歸變換器(右)。第一階段類似于原始的VQ-VAE訓(xùn)練程序。在第二階段,VQ-VAE將視頻數(shù)據(jù)編碼為潛在序列作為先驗(yàn)?zāi)P偷挠?xùn)練數(shù)據(jù)。對于推理階段,首先從先驗(yàn)中抽取一個(gè)潛在序列,然后用VQ-VAE將潛在序列解碼為視頻樣本 Learning Latent Codes 為了學(xué)習(xí)一組離散的潛在編碼,首先在視頻數(shù)據(jù)上訓(xùn)練一個(gè)VQ-VAE。編碼器結(jié)構(gòu)由一系列三維卷積組成,這些卷積在空間-時(shí)間上進(jìn)行下采樣,然后是注意力殘差塊。每個(gè)注意力殘差塊的設(shè)計(jì)如圖8所示,使用LayerNorm和軸向注意力層。解碼器的結(jié)構(gòu)與編碼器相反,注意力殘差塊之后是一系列的三維轉(zhuǎn)置卷積,在空間-時(shí)間上進(jìn)行上采樣。位置編碼是學(xué)習(xí)到的時(shí)空嵌入,在編碼器和解碼器的所有軸向注意力層之間共享。 圖8. VQVAE中注意力殘差塊的結(jié)構(gòu) Learning a Prior 第二階段是對第一階段的VQ-VAE潛在編碼進(jìn)行先驗(yàn)學(xué)習(xí)。遵循Image-GPT的先驗(yàn)網(wǎng)絡(luò)結(jié)構(gòu),只是在前饋層和注意力塊層之后增加了dropout層,用于正則化。盡管VQ-VAE是無條件訓(xùn)練的,但可以通過訓(xùn)練一個(gè)條件先驗(yàn)來生成條件樣本。可以使用兩種類型的條件。 交叉注意力(Cross Attention)。對于video frame conditioning,首先將調(diào)整后的幀送入一個(gè)3D ResNet,然后在之前的網(wǎng)絡(luò)訓(xùn)練中對ResNet的輸出表示進(jìn)行交叉注意力。 條件性范數(shù)(Conditional Norms)。與GANs中使用的調(diào)整方法類似,將transformer層歸一化層中的增益和偏置參數(shù)化為條件向量的仿射函數(shù)。這種方法可以用于行動(dòng)和類別調(diào)整模型。 當(dāng)前 SOTA!平臺(tái)收錄 VideoGPT 共 1 個(gè)模型實(shí)現(xiàn)資源。 項(xiàng)目SOTA!平臺(tái)項(xiàng)目詳情頁VideoGPT前往SOTA!模型平臺(tái)獲取實(shí)現(xiàn)資源:https://sota.jiqizhixin.com/project/videogpt DVG 在給定幾個(gè)背景(或過去)幀的情況下,生成未來幀是一項(xiàng)具有挑戰(zhàn)性的任務(wù)。它需要從潛在的未來狀態(tài)的多樣性方面對視頻的時(shí)間一致性和多模態(tài)進(jìn)行建模。目前用于視頻生成的變量方法傾向于將多模態(tài)的未來結(jié)果邊緣化。而多樣化視頻生成器(Diverse Video Generator,DVG)則是對未來結(jié)果中的多模態(tài)進(jìn)行明確建模,并利用它對不同的未來進(jìn)行采樣,DVG使用高斯過程(Gaussian Process,GP)來學(xué)習(xí)關(guān)于過去的未來狀態(tài)的先驗(yàn),并保持一個(gè)關(guān)于特定樣本的可能未來的概率分布。此外,利用這個(gè)分布的超時(shí)變化,通過估計(jì)正在進(jìn)行的序列的結(jié)束來控制不同未來狀態(tài)的采樣。即,利用GP在輸出函數(shù)空間上的方差來觸發(fā)行動(dòng)序列的變化。 使用高斯過程對未來狀態(tài)的多樣性進(jìn)行建模,是由于高斯過程具有幾個(gè)理想的特性:它們在貝葉斯公式中學(xué)習(xí)了關(guān)于給定過去背景的潛在未來的先驗(yàn)。這使得我們能夠在提供更多的背景框架作為證據(jù)時(shí)更新可能的未來分布,并保持一個(gè)潛在的未來列表(GP的基礎(chǔ)函數(shù))。DVG給出了一個(gè)非常有趣的formulation:估計(jì)何時(shí)生成一個(gè)不同的輸出與繼續(xù)一個(gè)正在進(jìn)行的行動(dòng),以及控制預(yù)測的未來的方法。 DVG利用GP在任何特定時(shí)間步長的方差作為行動(dòng)序列是否正在進(jìn)行或結(jié)束的指標(biāo),具體如圖9,當(dāng)觀察到一幀(例如在時(shí)間t)可能有幾種可能的未來時(shí),GP模型的方差很高(圖9(左))。不同的函數(shù)表征可以生成的潛在行動(dòng)序列,從這個(gè)特定的框架開始。一旦選擇了下一幀(t+2),未來狀態(tài)的GP方差相對較低(圖9(中)),表明一個(gè)行動(dòng)序列正在進(jìn)行中,模型應(yīng)該繼續(xù)它,而不是試圖對一個(gè)不同的樣本進(jìn)行采樣。在正在進(jìn)行的序列完成后,對潛在的未來狀態(tài)的GP方差又變得很高。這意味著我們可以繼續(xù)這一行動(dòng)。以上過程簡要說明了我們?nèi)绾问褂肎P來決定何時(shí)觸發(fā)不同的行動(dòng)。圖9(右)顯示了一個(gè)使用GP觸發(fā)器的例子,每隔幾幀就觸發(fā)一個(gè)不同的動(dòng)作。 圖19. 使用GP差異來控制正在進(jìn)行的行動(dòng)與新行動(dòng)的抽樣說明 給定一組觀察到的幀,目標(biāo)是生成一組多樣化的未來幀。DVG模型有三個(gè)模塊:(a)一個(gè)幀自動(dòng)編碼器(或編碼器生成器),(b)一個(gè)LSTM時(shí)間動(dòng)態(tài)編碼器,(c)一個(gè)GP時(shí)間動(dòng)態(tài)編碼器,用于對各種潛在的未來狀態(tài)進(jìn)行先驗(yàn)和概率建模。幀編碼器將幀映射到一個(gè)潛在的空間,隨后被時(shí)間動(dòng)力學(xué)編碼器和幀發(fā)生器利用來合成未來幀。對于推理階段,使用所有三個(gè)模塊一起生成未來幀,并使用GP作為觸發(fā)器來切換到不同的未來狀態(tài)。 所有三個(gè)模塊,幀自動(dòng)編碼器、LSTM及GP時(shí)間編碼器,是使用以下目標(biāo)函數(shù)聯(lián)合訓(xùn)練的: 在推理過程中,將上述的三個(gè)模塊組合在一起,將幀編碼器的輸出z_t輸入給LSTM和GP編碼器。LSTM輸出zt+1,GP輸出一個(gè)平均值和方差。GP的方差可以用來決定我們是否要繼續(xù)一個(gè)正在進(jìn)行的動(dòng)作或產(chǎn)生新的多樣化的輸出,這個(gè)過程稱之為觸發(fā)開關(guān)。如果決定繼續(xù)進(jìn)行正在進(jìn)行的動(dòng)作,將LSTM的輸出zt+1提供給解碼器以生成下一幀;如果決定切換,就從GP中取樣zt+1并將其作為輸入提供給解碼器。這個(gè)過程如圖10所示(stage 3)。將生成的未來幀用作編碼器的輸入,以輸出下一個(gè)z_(t+1);這個(gè)過程重復(fù)進(jìn)行,直到得到我們想要的生成幀。 圖10. DVG模型架構(gòu) 當(dāng)前 SOTA!平臺(tái)收錄DVG共 1個(gè)模型實(shí)現(xiàn)資源。 項(xiàng)目SOTA!平臺(tái)項(xiàng)目詳情頁DVG前往SOTA!模型平臺(tái)獲取實(shí)現(xiàn)資源:https://sota.jiqizhixin.com/project/dvg NWA NWA不是一個(gè)單純的視頻生成模型,而是一個(gè)多模態(tài)預(yù)訓(xùn)練模型。為了同時(shí)覆蓋語言、圖像和視頻的不同場景,NWA是一個(gè)三維變換器編碼器-解碼器框架,它不僅可以處理作為三維數(shù)據(jù)的視頻,還可以分別用于處理維和二維數(shù)據(jù)的文本和圖像。 為了涵蓋所有的文本、圖像和視頻或其草圖,將它們?nèi)恳暈閠oken,并定義了一個(gè)統(tǒng)一的三維符號(hào)X∈R_h×w×s×d,其中,h和w表示空間軸上的token數(shù)量(分別為高度和寬度),s表示時(shí)間軸上的token數(shù)量,d是每個(gè)token的尺寸。文本自然是離散的,繼Transformer之后,使用小寫的 byte pair encoding 字節(jié)對編碼(BPE)將其標(biāo)記化并嵌入到R_1×1×s×d。由于文本沒有空間維度,使用占位符1。圖像是自然的連續(xù)像素。輸入一個(gè)高度為H、寬度為W、通道為C的原始圖像I∈R_H×W×C,VQ-VAE訓(xùn)練一個(gè)可學(xué)習(xí)的 codebook ,在原始連續(xù)像素和離散token之間建立一個(gè)橋梁。 其中,E為編碼器。搜索到的結(jié)果z∈{0, 1, . . . , N - 1}_h×w被B嵌入,并由解碼器G重構(gòu)回I。VQ-VAE的訓(xùn)練損失函數(shù)為 VQ-GAN增強(qiáng)了VQ-VAE的訓(xùn)練,增加了感知損失和GAN損失,以減輕I和I之間的精確約束,并專注于高層次的語義匹配。 VQ-VAE訓(xùn)練后,B[z]為最終得到的圖像表征。 對于視頻,使用二維VQ-GAN對視頻的每一幀進(jìn)行編碼,也可以產(chǎn)生時(shí)間上的一致性視頻,并同時(shí)受益于圖像和視頻數(shù)據(jù)。由此生成的表征表示為R_h×w×s×d,其中,s表示幀的數(shù)量。 圖11. NUWA的結(jié)構(gòu)概述。它包含一個(gè)支持不同條件的自適應(yīng)編碼器和一個(gè)受益于圖像和視頻數(shù)據(jù)的預(yù)訓(xùn)練的解碼器。對于圖像補(bǔ)全、視頻預(yù)測、圖像操作和視頻操作任務(wù),輸入的部分圖像或視頻被直接送入解碼器 進(jìn)一步,引入一個(gè)3D近距離關(guān)注(3DNA)機(jī)制,以考慮空間和時(shí)間軸的定位特性。3DNA不僅降低了計(jì)算的復(fù)雜性,而且還提高了生成結(jié)果的視覺質(zhì)量。基于3DNA機(jī)制,引入一個(gè)3D encoder-decorder架構(gòu)。為了在C的條件下生成一個(gè)目標(biāo)Y,Y和C的位置編碼由三個(gè)不同的可學(xué)習(xí)詞匯更新,考慮到高度、寬度和時(shí)間軸: 然后,將條件送入一個(gè)由L個(gè)3DNA層堆疊而成的編碼器,以模擬自注意力的相互作用,其中第l層為: 同樣,解碼器也是一個(gè)由L個(gè)3DNA層組成的堆棧。解碼器同時(shí)計(jì)算生成結(jié)果的自注意力和生成結(jié)果與條件之間的交叉注意力: 在三個(gè)任務(wù)上訓(xùn)練模型時(shí)(文本到圖像( Text-to-Image,T2I)、視頻預(yù)測( Video Prediction ,V2V)和文本到視頻( Text-t,o-Video T2V)),訓(xùn)練目標(biāo)為交叉熵函數(shù),分別表示為三個(gè)部分: 當(dāng)前 SOTA!平臺(tái)收錄NWA 共 1個(gè)模型實(shí)現(xiàn)資源。 項(xiàng)目SOTA!平臺(tái)項(xiàng)目詳情頁NWA前往SOTA!模型平臺(tái)獲取實(shí)現(xiàn)資源:https://sota.jiqizhixin.com/project/nuwa StyleGAN-v 常用于視頻生成的Conv3D層有很多限制,比如計(jì)算成本相當(dāng)高。規(guī)避對3D卷積的需求的一個(gè)方法是將視頻作為一個(gè)具有時(shí)間坐標(biāo)的連續(xù)信號(hào)。為了使這種方法奏效,必須解決幾個(gè)問題:首先,現(xiàn)有的基于正弦/余弦的位置編碼是循環(huán)的,不依賴于輸入,這對視頻是不利的,因?yàn)槲覀兿M煌囊曨l在幀之間有不同的運(yùn)動(dòng),而且視頻不應(yīng)該循環(huán)。其次,對完整視頻的訓(xùn)練在計(jì)算上是很昂貴的,因此生成器必須能夠從每個(gè)片段只有幾幀的稀疏輸入中學(xué)習(xí)。最后,鑒別器需要處理以不同時(shí)間距離采樣的幀,以應(yīng)對稀疏的輸入問題。總之,StyleGAN-V不是自回歸的,不使用Conv3D,而是在稀疏的輸入上進(jìn)行訓(xùn)練,并且對圖像和視頻使用單一的鑒別器而不是兩個(gè)單獨(dú)的鑒別器。 StyleGAN-v是在StyleGAN2的基礎(chǔ)上建立的模型,并為視頻合成重新設(shè)計(jì)其生成器和鑒別器網(wǎng)絡(luò),只做了最小的修改。在StyleGAN2的生成器上所做的唯一修改是將連續(xù)運(yùn)動(dòng)編碼v_t與它的恒定輸入張量連接起來。將這些特征按通道串聯(lián)成一個(gè)全局視頻描述符h,并據(jù)此預(yù)測真/假。以幀之間的時(shí)間距離δxi = ti+1 - ti作為D的條件,以使它更容易在不同的幀率上操作。 1)生成器結(jié)構(gòu)。 生成器由三個(gè)子模塊組成:內(nèi)容映射網(wǎng)絡(luò)Fc、運(yùn)動(dòng)映射網(wǎng)絡(luò)Fm、Synthesis網(wǎng)絡(luò) S。Fc和S從StyleGAN2中照搬,只對S進(jìn)行了修改,將運(yùn)動(dòng)編碼v_t拼接到它的恒定輸入張量上。通過對一些內(nèi)容的噪聲進(jìn)行采樣并通過映射網(wǎng)絡(luò)得到視頻的風(fēng)格代碼,從而生成一個(gè)樣本視頻。然后,對于每個(gè)時(shí)間段取樣一個(gè)噪聲向量序列,該序列對應(yīng)于足夠長的等距時(shí)間段以覆蓋目標(biāo)時(shí)間段,通過兩個(gè)無填充的Conv1D層,并從輸出序列中對應(yīng)于目標(biāo)時(shí)間段左右兩個(gè)隨機(jī)時(shí)間段的兩個(gè)向量中計(jì)算出非循環(huán)位置編碼。由此產(chǎn)生的運(yùn)動(dòng)編碼被插入到生成器中。 圖12. 生成器架構(gòu):在StyleGAN2生成器的合成網(wǎng)絡(luò)S之上所做的唯一修改是將運(yùn)動(dòng)編碼與常量輸入張量相連接。S使用內(nèi)容編碼w和運(yùn)動(dòng)編碼v_t生成幀x_t 2)非周期性的位置編碼。 StyleGAN-V的位置編碼基本上是一個(gè)轉(zhuǎn)換的正弦函數(shù),具有可學(xué)習(xí)的波幅、周期、相位,首先預(yù)測來自目標(biāo)時(shí)間段左側(cè)的 "原始 "運(yùn)動(dòng)編碼。然而,這本身就導(dǎo)致了不相干的運(yùn)動(dòng)編碼,這就是為什么他們通過減去左右編碼之間的線性插值來縫合,以便在每個(gè)離散的時(shí)間步長(0,1,2,...)將嵌入歸零。這在一定程度上限制了位置編碼的表現(xiàn)力,所以為了彌補(bǔ)這一點(diǎn),將左右運(yùn)動(dòng)矢量之間的線性插值乘以一個(gè)可學(xué)習(xí)矩陣再加回去。它對向量進(jìn)行歸一化處理,然后用一個(gè)學(xué)習(xí)到的參數(shù)對其進(jìn)行歸一化處理。 3) 鑒別器結(jié)構(gòu)。 鑒別器獨(dú)立地從每一幀中提取特征,將結(jié)果連接起來,并從該張量中預(yù)測出一個(gè)單一的真/假邏輯。為了能夠處理稀疏的輸入,鑒別器以幀之間的時(shí)間距離為條件。這些距離通過位置編碼進(jìn)行預(yù)處理,然后通過MLP進(jìn)行處理,并串聯(lián)成一個(gè)單一的向量,用于調(diào)節(jié)每個(gè)鑒別器塊第一層的權(quán)重,以及最后一層的投影條件(點(diǎn)乘)。 圖13. 每段視頻k=3幀的鑒別器結(jié)構(gòu)。在StyleGAN2鑒別器的基礎(chǔ)上所做的唯一變化是在16個(gè)分辨率下串聯(lián)激活通道,并在幀間時(shí)間距離的位置嵌入上調(diào)節(jié)模型 4) 稀疏訓(xùn)練的隱含假設(shè)。 在一個(gè)視頻中,幀的變化不大(人臉、延時(shí)攝影等)。因此,僅僅幾幀就包含了足夠的信息來了解整個(gè)視頻的情況。例如,如果你看過兩幀,你就已經(jīng)看到了它們的全部。 當(dāng)前 SOTA!平臺(tái)收錄 StyleGAN-v共1個(gè)模型實(shí)現(xiàn)資源。 模型SOTA!平臺(tái)模型詳情頁StyleGAN-v前往SOTA!模型平臺(tái)獲取實(shí)現(xiàn)資源:https://sota.jiqizhixin.com/project/stylegan-v Video Diffusion Models 生成時(shí)間上連貫的高保真視頻是生成式模型研究的一個(gè)重要里程碑。Video Diffusion Models 是一個(gè)用于視頻生成的擴(kuò)散模型,它是標(biāo)準(zhǔn)圖像擴(kuò)散架構(gòu)的自然擴(kuò)展,能夠從圖像和視頻數(shù)據(jù)中進(jìn)行聯(lián)合訓(xùn)練,從而減少mini-batch梯度的方差并加快優(yōu)化速度。為了生成長的和更高分辨率的視頻,Video Diffusion Models中引入了一種新的條件采樣技術(shù),用于空間和時(shí)間上的視頻擴(kuò)展,比以前提出的方法表現(xiàn)得更好。 在圖像生成TOP模型的文章中,我們介紹過Unet,這是一個(gè)神經(jīng)網(wǎng)絡(luò)架構(gòu),構(gòu)建為一個(gè)空間下采樣通道,然后是一個(gè)空間上采樣通道,與下采樣通道的激活有 skip connections 。該網(wǎng)絡(luò)是由二維卷積塊層構(gòu)建的。Video Diffusion Models將這種圖像擴(kuò)散模型架構(gòu)擴(kuò)展到視頻數(shù)據(jù),由固定數(shù)量的幀塊給出,使用一種特殊類型的3D U-Net,在空間和時(shí)間上進(jìn)行因子化。首先,修改了圖像模型結(jié)構(gòu),將每個(gè)二維卷積改變?yōu)榧兛臻g的三維卷積,例如,將每個(gè)3x3卷積改變?yōu)?x3x3卷積(第一個(gè)索引視頻幀,第二個(gè)和第三個(gè)索引空間高度和寬度)。每個(gè)空間注意力塊中的注意力仍然是對空間的注意力。也就是說,第一軸被當(dāng)作一個(gè)batch axis。其次,在每個(gè)空間注意力塊之后,插入一個(gè)時(shí)間注意力塊,對第一個(gè)軸進(jìn)行注意力,并將空間軸視為批處理軸。在每個(gè)時(shí)間注意力塊中使用相對位置嵌入,以便網(wǎng)絡(luò)能夠以不需要視頻時(shí)間的絕對概念的方式區(qū)分幀的排序。圖24中可視化了模型的結(jié)構(gòu)。 圖24. 擴(kuò)散模型中xθ的三維U-Net結(jié)構(gòu)。每個(gè)區(qū)塊代表一個(gè)4D張量,其軸標(biāo)記為幀×高×寬×通道,以時(shí)空因子的方式處理。輸入為噪聲視頻z_t、調(diào)節(jié)c和log SNR λ_t。下采樣/上采樣塊通過每個(gè)K塊調(diào)整空間輸入分辨率的高度×寬度,系數(shù)為2。通道數(shù)用通道乘法器M1、M2、...、MK指定,上采樣通道與下采樣通道有skip connections連接 當(dāng)前 SOTA!平臺(tái)收錄 Video Diffusion Models 共2個(gè)模型實(shí)現(xiàn)資源。 項(xiàng)目SOTA!平臺(tái)項(xiàng)目詳情頁Video Diffusion Models前往SOTA!模型平臺(tái)獲取實(shí)現(xiàn)資源:https://sota.jiqizhixin.com/project/video-diffusion-models前往 SOTA!模型資源站(sota.jiqizhixin.com)即可獲取本文中包含的模型實(shí)現(xiàn)代碼、預(yù)訓(xùn)練模型及API等資源。 網(wǎng)頁端訪問:在瀏覽器地址欄輸入新版站點(diǎn)地址sota.jiqizhixin.com,即可前往「SOTA!模型」平臺(tái),查看關(guān)注的模型是否有新資源收錄。 移動(dòng)端訪問:在微信移動(dòng)端中搜索服務(wù)號(hào)名稱「機(jī)器之心SOTA模型」或 ID「sotaai」,關(guān)注 SOTA!模型服務(wù)號(hào),即可通過服務(wù)號(hào)底部菜單欄使用平臺(tái)功能,更有最新AI技術(shù)、開發(fā)資源及社區(qū)動(dòng)態(tài)定期推送。

-

宋河酒業(yè)申請破產(chǎn)重整,昔日“豫酒老大”能否涅槃重生?

頭條 22-11-13

-

多家券商發(fā)力另類投資業(yè)務(wù),跟注冊制有關(guān),部分已盈利

頭條 22-11-13

-

魯山縣關(guān)于暫停餐飲服務(wù)場所堂食的通告

頭條 22-11-13

-

當(dāng)前快看:河南昨日新增本土242+2423

頭條 22-11-13

-

熱點(diǎn)聚焦:國家衛(wèi)健委:昨日新增本土感染者1675+13086例

頭條 22-11-13

-

當(dāng)前最新:全國首家!河南成立現(xiàn)代預(yù)制菜行業(yè)學(xué)院

頭條 22-11-12

-

當(dāng)前視訊!羅永浩居首!淘寶新主播雙11成交額同比增345%

頭條 22-11-12

-

國家虛擬現(xiàn)實(shí)創(chuàng)新中心在南昌揭牌

頭條 22-11-12

-

鄭州富士康員工餐廳有啥新變化?戳視頻 ↓

頭條 22-11-12

-

快報(bào):直擊鄭州富士康一線 | 園區(qū)堂食有了更多選擇

頭條 22-11-12

-

速遞!杭州樓市松綁:“認(rèn)房不認(rèn)貸”,二套首付降至4成

頭條 22-11-12

-

天天日報(bào)丨直擊鄭州富士康一線 | 心理援助醫(yī)療隊(duì)專家在員工公寓坐診

頭條 22-11-12

-

鄭州富士康改造后的員工公寓咋樣?有圖有視頻→

頭條 22-11-12

-

天貓雙11收官:交易規(guī)模與去年持平 折射中國消費(fèi)新趨勢

頭條 22-11-12

-

交通運(yùn)輸部:調(diào)整跨省客運(yùn)和跨城公交、出租等防控政策

頭條 22-11-12

-

國家衛(wèi)健委:昨日新增本土1452+10351

頭條 22-11-12

-

三季度基金代銷百強(qiáng)榜單出爐 券商占據(jù)半數(shù)以上席位

頭條 22-11-12

-

環(huán)球播報(bào):河南昨日新增本土107+2057

頭條 22-11-12

-

全球今亮點(diǎn)!隔夜歐美·11月12日

頭條 22-11-12

-

焦點(diǎn)報(bào)道:天舟五號(hào)貨運(yùn)飛船將于今日上午發(fā)射

頭條 22-11-12

-

每日速看!杭州樓市大消息!

頭條 22-11-12

-

焦點(diǎn)熱門:立方風(fēng)控鳥·早報(bào)(11月12日)

頭條 22-11-12

-

今日觀點(diǎn)!天貓雙11交易規(guī)模與去年持平

頭條 22-11-12

-

微資訊!天貓雙11收官:交易規(guī)模與去年持平,首次未披露總交易額

頭條 22-11-12

-

每日訊息!2022年雙11收官,卻沒有GMV

頭條 22-11-12

-

這屆雙11,“貓狗”爭當(dāng)農(nóng)貨“帶貨王”

頭條 22-11-12

-

今日觀點(diǎn)!鄭州富士康招工調(diào)查:有人積極報(bào)名,有人還在觀望

頭條 22-11-11

-

阿里巴巴戴珊:天貓雙11見證中國消費(fèi)活力

頭條 22-11-11

-

五部門:支持培育一批智能光伏示范企業(yè)、建設(shè)一批智能光伏示范項(xiàng)目

頭條 22-11-11

-

雙十一認(rèn)領(lǐng)生豬獲得收益? 牧原股份緊急回應(yīng):電信詐騙

頭條 22-11-11

-

竇賢康任國家自然科學(xué)基金委員會(huì)黨組書記

頭條 22-11-11

-

看熱訊:國家能源局組織召開加快儲(chǔ)氣能力建設(shè)專題推進(jìn)會(huì)

頭條 22-11-11

-

提振消費(fèi)活力和商家信心,數(shù)字化成雙11中的關(guān)鍵變量

頭條 22-11-11

-

世界觀焦點(diǎn):重磅!北交所推出融資融券制度

頭條 22-11-11

-

全球簡訊:立方風(fēng)控鳥·晚報(bào)(11月11日)

頭條 22-11-11

-

天天視點(diǎn)!阿里吹雪:今年天貓雙11穩(wěn)中向好,2.5萬爆款單品銷售過百萬

頭條 22-11-11

- 世界焦點(diǎn)!TGANv2、VideoGPT、DVG …你都2022-11-13

- 全球報(bào)道:閑來札記:延遲滿足、時(shí)間尺子、2022-11-13

- 妻子臨產(chǎn)丈夫訂花寄語不必為母則剛:希望你2022-11-13

- 網(wǎng)店聲明“僅配續(xù)航電源”,買家以無原裝為2022-11-13

- 環(huán)球頭條:一場秋雨一場寒,長沙最高氣溫將2022-11-13

- 每日熱文:海報(bào)丨珍愛濕地 人與自然和諧共2022-11-13

- 熱門:漢威科技擬4.87億元轉(zhuǎn)讓子公司,聚焦2022-11-13

- 11月15日起,鄭州高新區(qū)政務(wù)服務(wù)大廳有序分2022-11-13

- 當(dāng)前關(guān)注:因存在較大不確定性,神火股份決2022-11-13

- 全球信息:蔬菜便宜了!市民吃便宜菜或持續(xù)2022-11-13

- 「行走河南·讀懂中國」雪落老君山,來赴一2022-11-13

- 視焦點(diǎn)訊!感受武漢的濕韻,“濕地小衛(wèi)士”2022-11-13

- 五代傳承的焦作名小吃!這碗豆沫我干了!2022-11-13

- 【世界新視野】課本里的戲曲:"沉浸式"賞戲2022-11-13

- 當(dāng)前要聞:神舟十四號(hào)航天員進(jìn)入天舟五號(hào)貨2022-11-13

- 全球聚焦:重返巔峰!張偉麗奪回 UFC 世2022-11-13

- 【世界時(shí)快訊】呼和浩特:一公司錯(cuò)報(bào)核酸檢2022-11-13

- 為了減肥,她們將“仙女管”插入胃里 50 2022-11-13

- 微速訊:相親時(shí)姑娘一句話,小伙越想越怕:2022-11-13

- 滾動(dòng):首批個(gè)人養(yǎng)老金基金亮相!新增份額實(shí)2022-11-13

- 觀天下!“顱內(nèi)出血,快點(diǎn)快點(diǎn)……讓讓,讓2022-11-13

- 每天1億多件快遞包裹進(jìn)出農(nóng)村 我國正健全2022-11-13

- 世界實(shí)時(shí):鄭州市二七區(qū)新冠肺炎疫情防控指2022-11-13

- 環(huán)球今熱點(diǎn):29歲博士因社恐1月叫2次救護(hù)車2022-11-13

- 宋河酒業(yè)申請破產(chǎn)重整,昔日“豫酒老大”能2022-11-13

- 張偉麗重新奪回金腰帶,成為UFC史上僅有的42022-11-13

- 當(dāng)前視點(diǎn)!內(nèi)蒙古一核酸檢測機(jī)構(gòu)錯(cuò)報(bào)結(jié)果,2022-11-13

- 多家券商發(fā)力另類投資業(yè)務(wù),跟注冊制有關(guān),2022-11-13

- 當(dāng)前熱點(diǎn)-長沙一小區(qū)封窗工人從8樓墜亡,現(xiàn)2022-11-13

- 新消息丨鄭州市上街區(qū)新冠肺炎疫情防控指揮2022-11-13

精彩推薦

閱讀排行

- 【世界新視野】課本里的戲曲:"沉浸式"賞戲,是一種什么體驗(yàn)?

- 今日要聞!象?面孔丨“太空快遞”背后的河南航天人段旭升:6歲埋下航天夢,已參與17次發(fā)射任務(wù)

- 當(dāng)前消息!記者手記 | 他們讓我懂得,珍惜當(dāng)下 感恩父母!

- 環(huán)球觀察:河南首批省級(jí)考古遺址公園立項(xiàng)名單公布

- 當(dāng)前短訊!天氣轉(zhuǎn)晴!河南本輪寒潮天氣結(jié)束,14日清晨氣溫較低

- 今評彈|聯(lián)系不上就讓大學(xué)生退學(xué),這個(gè)草率的公告能推翻嗎?

- 焦點(diǎn)精選!今評彈|在封控區(qū)無償送藥,善良的鄭州人正散發(fā)著溫暖的光

- 環(huán)球快播:河南下雪了!來看銀裝素裹的南陽老界嶺

- 環(huán)球觀天下!如何評價(jià)“我們這十年”?

- 我的奮斗丨快遞小哥自述疫情下堅(jiān)守30天:這時(shí)候的包裹關(guān)乎每個(gè)家庭,我們不能停